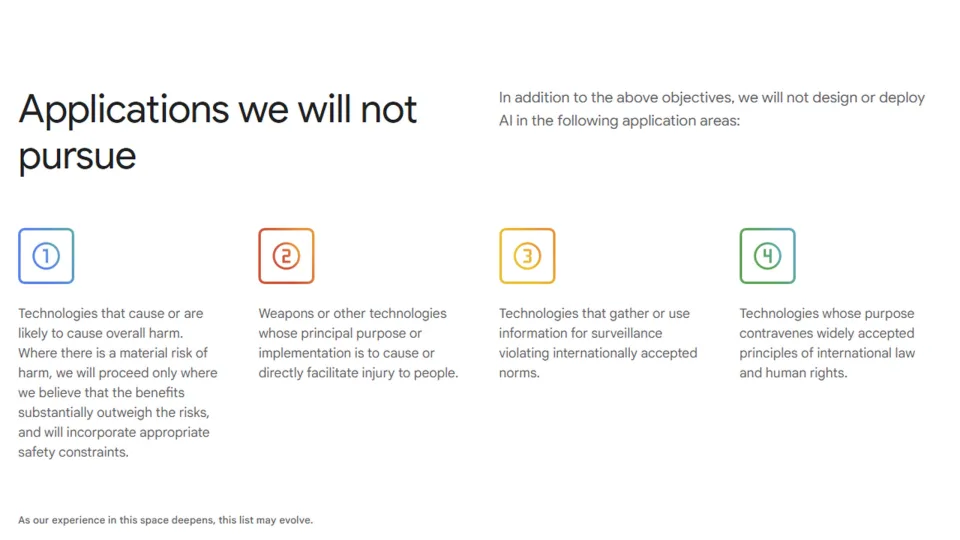

Компанія Google внесла одну з найсуттєвіших змін до своїх принципів у сфері штучного інтелекту з моменту їхньої першої публікації у 2018 році. Пошуковий гігант відредагував документ, вилучивши з нього обіцянки, що він не буде «розробляти або розгортати» інструменти ШІ для використання у зброї або технологіях спостереження. Раніше ці принципи містили розділ під назвою «застосування, які ми не будемо використовувати», який відсутній у новій версії документа.

Натомість з’явився розділ під назвою «Відповідальна розробка та розгортання». В AI principles Google заявляє, що впроваджуватиме «відповідний людський нагляд, належну перевірку та механізми зворотного зв’язку для узгодження з цілями користувачів, соціальною відповідальністю та загальноприйнятими принципами міжнародного права і прав людини», пише Engadget.

Це набагато ширші зобов’язання, ніж ті, які компанія взяла на себе у передній версії принципів ШІ. Наприклад, щодо зброї компанія раніше заявляла, що не розроблятиме ШІ для використання в «зброї або інших технологіях, основною метою або застосування яких є заподіяння або безпосереднє сприяння заподіянню шкоди людям». Що стосується інструментів спостереження за допомогою ШІ, компанія заявила, що не розроблятиме технології, які порушують «міжнародно прийняті норми».

На прохання прокоментувати ситуацію представник Google вказав Engadget на публікацію в блозі, яку компанія опублікувала в четвер. У ньому генеральний директор DeepMind Деміс Хассабіс і Джеймс Маньяка, старший віце-президент Google з досліджень, лабораторій, технологій і суспільства, стверджують, що поява ШІ як «технології загального призначення» вимагала зміни політики.

«Ми вважаємо, що демократії повинні лідирувати в розвитку штучного інтелекту, керуючись такими основними цінностями, як свобода, рівність і повага до прав людини. І ми віримо, що компанії, уряди та організації, які поділяють ці цінності, повинні працювати разом, щоб створити штучний інтелект, який захищає людей, сприяє глобальному зростанню та підтримує національну безпеку», — написали вони. «… Керуючись нашими принципами штучного інтелекту, ми й надалі зосереджуватимемося на дослідженнях і застосуваннях штучного інтелекту, які відповідають нашій місії, нашій науковій спрямованості та сферам наших знань, і залишатимемось узгодженими з широко визнаними принципами міжнародного права та прав людини — завжди оцінюючи конкретну роботу, ретельно оцінюючи, чи суттєво переваги переважають потенційні ризики».